Pruna AI 发布开源 AI 模型优化框架,推动高效模型压缩

Pruna AI 是一家来自欧洲的初创公司,专注于 AI 模型压缩算法的开发。近日,该公司宣布将其优化框架开源,旨在帮助开发者更高效地压缩和优化 AI 模型。

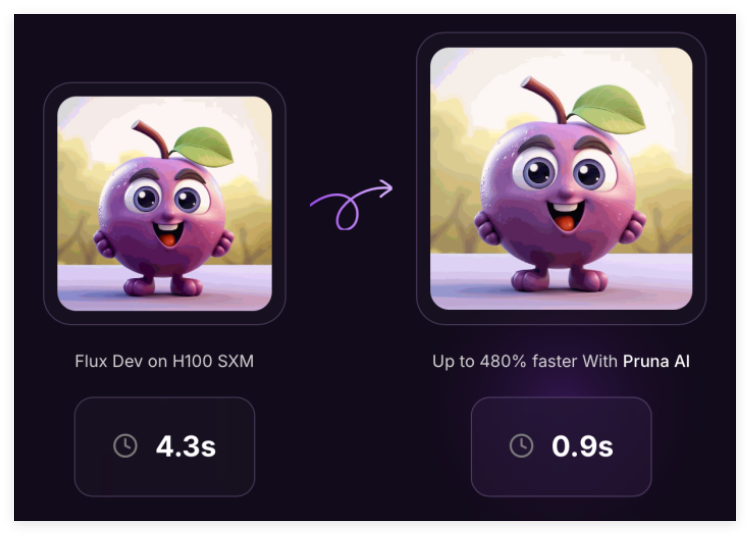

Pruna AI 开发的框架整合了多种高效压缩技术,包括缓存、剪枝、量化和蒸馏等方法,显著提升了 AI 模型的性能。该框架不仅标准化了压缩模型的保存与加载流程,还能对压缩后的模型进行评估,确保其质量不会显著下降,同时精确测量压缩带来的性能提升。

Pruna AI 的联合创始人兼首席技术官约翰・拉赫万(John Rachwan)表示:“我们的框架类似于 Hugging Face 对 transformers 和 diffusers 的标准化,我们为各类效率方法提供了一种统一的调用和使用方式。” 目前,许多大公司如 OpenAI 已经在模型中应用了多种压缩技术,例如通过蒸馏技术创建其旗舰模型的轻量版本。

蒸馏是一种通过“教师-学生”模型传递知识的技术。开发者向教师模型发送请求并记录输出,随后利用这些输出训练学生模型,使其能够近似教师模型的行为。拉赫万指出,尽管大公司倾向于自行构建压缩工具,但开源社区通常只能提供基于单一方法的解决方案。Pruna AI 的框架则整合了多种方法,极大地简化了使用流程。

目前,Pruna AI 的框架支持多种模型类型,包括大型语言模型、扩散模型、语音识别模型和计算机视觉模型。不过,该公司当前主要专注于图像和视频生成模型的优化。已有 Scenario 和 PhotoRoom 等企业采用了 Pruna AI 的服务。

除了开源版本,Pruna AI 还推出了企业版,提供高级优化功能和优化代理。拉赫万透露:“我们即将发布的最令人兴奋的功能是压缩代理。用户只需提供模型并设定速度和准确度的要求,代理将自动找到最佳的压缩组合。”

Pruna AI 采用按小时收费的模式,类似于用户在云服务上租用 GPU 的方式。通过使用优化后的模型,企业可以在推理阶段节省大量成本。例如,Pruna AI 成功将一个 Llama 模型的体积缩小了八倍,且几乎未损失精度。该公司希望客户将其压缩框架视为一种投资,最终获得显著回报。

近日,Pruna AI 完成了 650 万美元的种子轮融资,投资者包括 EQT Ventures、Daphni、Motier Ventures 和 Kima Ventures。

项目地址:Pruna AI GitHub